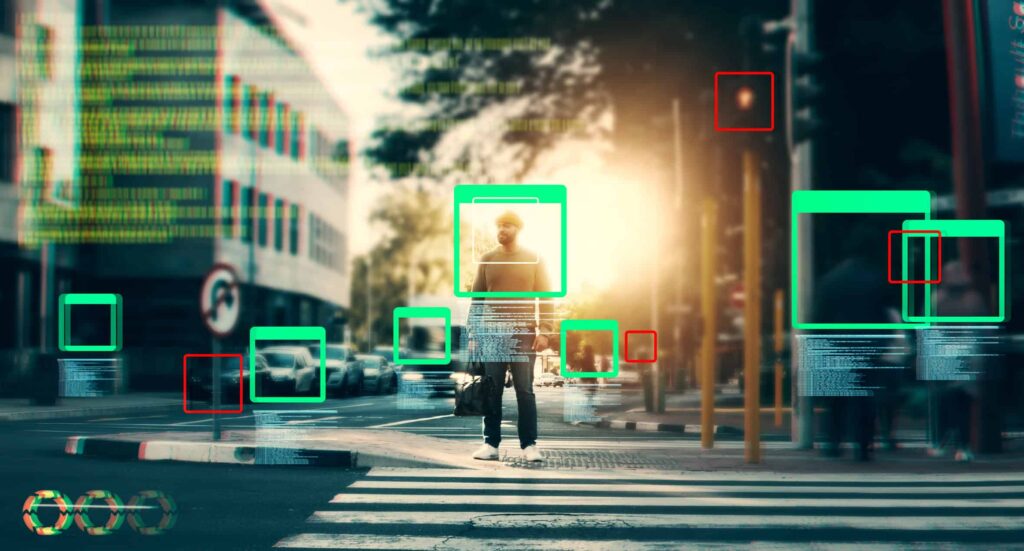

O aperfeiçoamento da tecnologia pode servir para melhorar a qualidade de vida da população. Um exemplo disso são os cada vez mais sofisticados sistemas de reconhecimento facial existentes, inclusive no Brasil.

O problema é que muitos destes serviços ainda apresentam falhas. A principal delas é a falta de transparência no uso dos recursos pelas autoridades brasileiras, segundo constatou uma pesquisa sobre o tema.

Faltam regras claras para o uso dos sistemas

- O Centro de Estudos de Segurança e Cidadania (CESeC) e a Defensoria Pública da União (DPU) analisaram como é feito o uso de sistemas de reconhecimento facial pelas polícias brasileiras.

- No entanto, este trabalho revelou informações preocupantes e que foram publicadas no relatório Mapeando a Vigilância Biométrica.

- Poucos foram os estados que responderam aos ofícios no prazo estipulado, sendo necessário um segundo pedido oficial.

- Mesmo com a insistência, quatro governos – Amazonas, Maranhão, Paraíba e Sergipe – ignoraram todos os prazos, violando as regras de acesso à informação.

- As conclusões do levantamento mostram que o reconhecimento facial avançou rapidamente no Brasil, mas sem parâmetros claros de eficácia ou respeito aos direitos da população.

Leia mais

Falhas evidenciam preconceito contra grupos específicos

Segundo artigo publicado no portal The Conversation pelo coordenador do Centro de Estudos de Segurança e Cidadania (CESeC), Pablo Nunes, e pela Doutora em Teorias Jurídicas Contemporâneas pela Universidade Federal do Rio de Janeiro (UFRJ), Carolina Castelliano, existem hoje 376 projetos ativos, capazes de vigiar cerca de 83 milhões de pessoas – quase 40% da população brasileira.

Faltam, porém, evidências de impacto positivo. Nenhum estado divulga relatórios públicos sobre erros de identificação, falsos positivos ou prisões equivocadas. A maioria tampouco comunica a Autoridade Nacional de Proteção de Dados quando terceiriza o processamento das imagens – obrigação expressa pela LGPD. É a normalização da exceção: enquanto outras jurisdições tratam o reconhecimento facial como tecnologia de “alto risco”, aqui ele se espalha sem avaliação prévia de impacto ou auditoria independente.

Artigo publicado no The Conversation

Em São Paulo, o programa Smart Sampa instalou câmeras em estações de metrô, escolas e Unidades Básicas de Saúde (UBSs). Apesar de se apresentar como o maior sistema de monitoramento de segurança da América Latina, ele já apresentou alguns erros. Em um dos casos, uma mulher grávida foi apontada como sendo criminosa e, devido ao estresse e ao medo, teve parto prematuro. Em outra situação, um idoso, jardineiro voluntário, teve que passar mais de 10h em uma delegacia para provar que era inocente.

As falhas ainda revelam o racismo sistêmico brasileiro. Estudos de referência mostram taxas de erro até cem vezes maiores para pessoas não brancas, e dados do monitor indicam que em 2019 mais de 90% dos presos por engano eram negros. Em vez de ponte para serviços, a câmera se converte em mais um obstáculo.

Para gestores públicos, adotar essas ferramentas oferece uma solução aparentemente moderna, que gera manchetes e sinaliza ação, mesmo sem comprovação de eficácia. Além disso, o custo político da vigilância é baixo: ela recai desproporcionalmente sobre populações negras e periféricas, com pouco acesso a meios de contestação judicial ou midiática. O resultado é a consolidação de um modelo de segurança que expande o controle, mas não necessariamente os direitos.

Artigo publicado no The Conversation

A conclusão do trabalho é que a legislação de acesso à informação, sozinha, não garante transparência quando o tema é segurança pública. Além disso, existe muita confusão dentro dos próprios governos sobre quem opera e quem fiscaliza a tecnologia: 70% delegam o sistema à Secretaria de Segurança, mas quase um quarto envolve empresas privadas em alguma etapa sensível. Esse cenário aumenta o risco de vazamentos ou usos indevidos dos dados faciais.

A recomendação dos pesquisadores é que a aquisição destas ferramentas seja suspensa até que exista uma lei federal específica. Além disso, é necessário exigir mapas de câmeras, publicação de contratos e auditorias periódicas, bem como padronizar abordagens e registrar a informação no auto de prisão. Estes passos alinhariam as nossas ferramentas ao padrão europeu que classifica o reconhecimento facial como categoria de “alto risco” e submete seu acionamento a controle judicial e temporal estrito.